Romantische KI-Chatbots sind gefährlich! Mozilla untersuchte mehrere KI-Chatbots und präsentiert das Prädikat 'Privacy Not Included'.

Sehnsucht nach einem Begleiter im tristen Alltag? Vielleicht möchtest du es einmal mit künstlicher Intelligenz versuchen? Doch während du dich in diese digitale Romanze stürzt, lauert im Hintergrund eine düstere Wahrheit. Laut einer aktuellen Studie des Mozilla-Projekts „Privacy Not Included“ sammeln diese Romantischen KI-Chatbots eine beunruhigend große Menge an persönlichen Informationen, die sie dann verkaufen oder weitergeben.

Die Illusion der Nähe: KI-Chatbots als Meister der Datensammlung

Misha Rykov, Forscher bei Mozilla, bringt es auf den Punkt: „Lass dich nicht täuschen – Romantische KI-Chatbots sind keine echten Freunde. Trotz des Versprechens, die geistige Gesundheit zu verbessern, sind sie darauf ausgelegt, Abhängigkeit und Einsamkeit zu fördern. Gleichzeitig sollen sie so viele Daten wie möglich über dich sammeln„.

Mozilla hat 11 verschiedene KI-Chatbots untersucht. Darunter beliebte Apps wie Replika, Chai, Romantic AI, EVA AI Chat Bot & Soulmate und CrushOn.AI. Alle erhielten das Prädikat „Privacy Not Included„. Das bedeutet, dass sie zu den bedenklichsten Produkten gehören, die Mozilla jemals getestet hat.

Die Datenschutzproblematik bei romantischen KI-Chatbots geht über das übliche Maß hinaus. CrushOn.AI beispielsweise sammelt intime Details wie Informationen über die sexuelle Gesundheit und die Einnahme von Medikamenten. Alarmierend ist auch, dass 90 Prozent dieser Apps Nutzerdaten für Werbung und andere Zwecke verkaufen oder weitergeben können, ohne dass die Nutzer die Möglichkeit haben, ihre Daten zu löschen.

Sicherheitsbedenken und Datenflut: Ein Blick auf die Zahlen

Nur eine Anwendung, Genesia AI Friend & Partner, erfüllte die Mindestsicherheitsstandards von Mozilla. Die meisten anderen KI-Chatbots wiesen eklatante Sicherheitsmängel auf. Besonders besorgniserregend ist die hohe Anzahl an Trackern, die in diesen Apps verwendet werden. Im Durchschnitt setzen die AI-Friends-Apps 2663 Tracker pro Minute ein. Romantic AI sticht mit 24.354 Trackern in nur einer Minute Nutzung besonders hervor.

Die Apps fordern die Nutzer aktiv dazu auf, sehr persönliche Informationen preiszugeben. EVA AI Chat Bot & Soulmate fordert die Nutzer auf, „alle Geheimnisse und Wünsche zu teilen“, einschließlich Fotos und Sprachaufnahmen.

Abgesehen von den Datenschutzproblemen stellen viele dieser Apps fragwürdige Behauptungen über ihren Nutzen auf. Bei genauerem Hinsehen distanzieren sie sich jedoch in ihren Allgemeinen Geschäftsbedingungen von diesen Versprechungen. Dies berichtet Gizmodo in einem aktuellen Artikel.

Romantische KI-Chatbots: Eine Gefahr für Datenschutz und psychische Gesundheit!

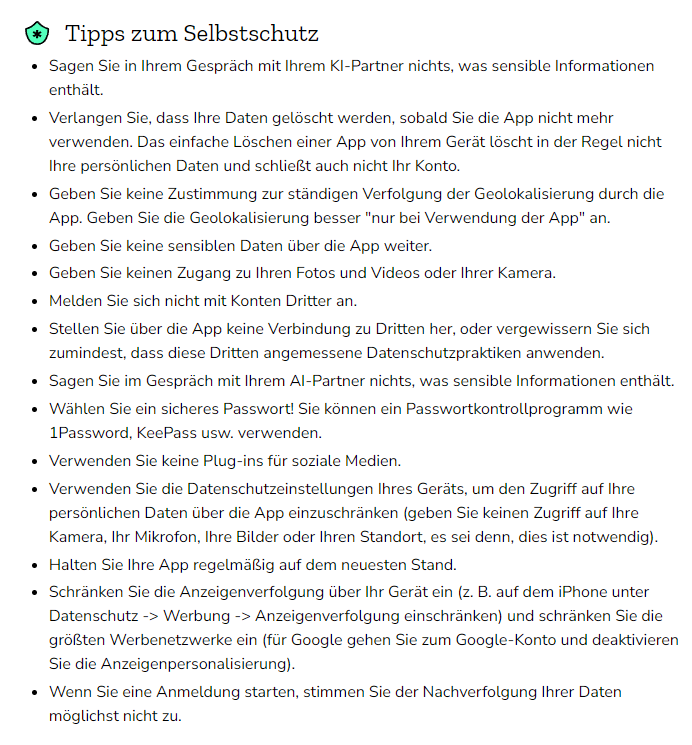

Der vermeintliche Ausweg aus der Einsamkeit birgt also viele Risiken. KI-Freunde bieten zwar Gesellschaft, aber zu welchem Preis? Die Datensicherheit und das Wohlergehen der Nutzer stehen auf dem Spiel. Es ist daher dringend notwendig, dass Regulierungsbehörden und Verbraucher die Augen offen halten und sich der Risiken bewusst werden, die diese scheinbar harmlosen Chatbots mit sich bringen.