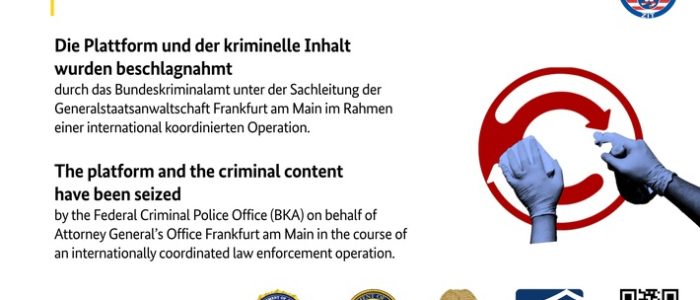

Das in Kraft getretene EU-Gesetz schreibt Online-Plattformen vor, sie haben maximal 60 Minuten Zeit, um terroristische Inhalte zu entfernen.

Sollte ein Technologieunternehmen wiederholt nicht schnell genug gegen terroristische Inhalte vorgehen, dann droht dem Unternehmen eine Geldstrafe von bis zu 4 Prozent ihres weltweiten Umsatzes. Die Verordnung ist seit dem 07. Juni 2022 anwendbar.

Und die Definition dessen, was unter das Verbot fallen könnte, hat die EU unglaublich weit gefasst. Dazu gehören laut der Verordnung (EU) 2021/784 Texte, Bilder, Tonaufnahmen und Videos sowie Live-Übertragungen von terroristischen Straftaten.

Kann man so den Terrorismus erfolgreich bekämpfen?

Mit der Verordnung will die EU sicherstellen, dass terroristische Propaganda in sozialen Netzwerken zeitnah entfernt werden. Die Betreibergesellschaften müssen zudem sicherstellen, dass ähnliche Inhalte nicht erneut hochgeladen werden können. Man muss die Nutzer aufklären, warum man ihre Inhalte entfernt hat. Der Nutzer des sozialen Netzwerks darf die Entscheidung anfechten. Doch ob das viel bringen wird?

Die EU-Verordnung wurde bereits im Jahr 2021 verabschiedet. Alle möglichen Behörden wie Strafverfolgungsbehörden, Innenministerien und Europol dürfen nun von einer Plattform oder einem Cloud-Dienst verlangen, bestimmte Posts, Musik, Livestreams, Fotos und Videos zu entfernen, die zu Gewalt aufrufen und terroristische Anschläge verherrlichen. Auch die Werbung für terroristische Vereinigungen und Anleitungen zur Durchführung von Anschlägen werden online verboten. Für Internet-Anbieter und Hosting-Provider gilt die Regelung übrigens schon länger. In Deutschland soll bei sozialen Netzwerken das BKA für die Meldung derartiger Inhalte zuständig sein.

Wer nicht sofort reagiert, riskiert riesige Strafzahlungen

Im Grunde haben die Unternehmen also eine Stunde Zeit, um die gemeldeten Medien inhaltlich zu prüfen. Sollte man aus Versehen häufiger nicht löschen, kann dieser Fehler Facebook oder Google unzählige Millionen Euro kosten. Was wird wohl passieren, sobald dort eine Löschaufforderung eintrudelt? Schon zur eigenen Sicherheit und zum Schutz vor gigantischen Strafzahlungen werden die Firmen alle gemeldeten Inhalte ohne jede Prüfung von den eigenen Servern entfernen. Das Nachsehen haben wieder einmal die User. Riesen Strafen und so gut wie keine Zeit, was kann da schon schiefgehen, meint auch der techdirt-Redakteur Mike Masnick. Natürlich ist das ironisch gemeint.

Terrorismus: Liste der falsch gemeldeten Inhalte sehr lang

Dazu kommt, dass es in der Vergangenheit schon häufiger zu fehlerhaften Meldungen gekommen ist. Facebook löschte zahlreiche Konten von Aktivisten und Journalisten, weil man ihre Berichte fälschlicherweise als terroristische Inhalte gekennzeichnet hatte. Auch hat man YouTube einst dazu angehalten, zeitnah ein angeblich terroristisches Video zu löschen. In Wahrheit war dies eine Dokumentation über Kriegsverbrechen. Harmlos also. Oder denken wir an die Löschaufforderung aus Frankreich, weil angeblich große Teile vom Internet Archive fragwürdige Inhalte beinhaltet haben soll. Wie man sieht, ist in der Vergangenheit schon jede Menge falsch gelaufen.

EU hat sich mit der Verordnung 2021/784 selbst übertroffen

Aktuelle Untersuchungen zu diesem Thema legen übrigens nahe, dass die Entfernung terroristischer Inhalte nicht das Geringste zur Verhinderung terroristischer Handlungen beiträgt. Die Forschungsergebnisse deuten sogar darauf hin, dass man besser auf terroristische Bedrohungen reagieren kann, wenn solche Inhalte weiterhin öffentlich zugänglich sind.

Bundesinnenministerin Nancy Faeser hingegen bezeichnet die strikte Vorgabe als „Meilenstein„. Diese Form der Rechtsdurchsetzung sei angeblich ein „weiterer wichtiger Schritt, um die Spirale von Hass und Gewalt auf digitalen Plattformen zu stoppen„.