Wissenschaftler haben ein ChatGPT-ähnliches KI-Modell, das GPT-1, mit fMRI-Messwerten trainiert, um Gedanken von Probanden zu entschlüsseln.

In einer aktuellen Studie stellen Wissenschaftler einen neuen Ansatz vor, die Gedanken von Menschen zu entschlüsseln. GPT-1-KI in Kombination mit Gehirnscans soll dies ermöglichen. Dabei kann ein Sprachdecoder die Gedanken einer Person in Text übersetzen. Dieser setzt dazu einen Transformator für künstliche Intelligenz (KI) ähnlich wie ChatGPT ein.

Das Forscherteam teilte am Montag mit, dass sie einen Weg gefunden haben, Gehirnscans und künstliche Intelligenzmodelle zu verwenden, um „das Wesentliche“ dessen, was Menschen denken, zu transkribieren.

Die Forscher sehen die Hauptfunktion ihres Sprachdecoders darin, Menschen helfen zu wollen, die die Fähigkeit zur Kommunikation verloren haben. Jedoch räumten sie auch ein, dass ihre Technologie durchaus Fragen zur „mentalen Privatsphäre“ aufwirft. Denkbar wäre für sie ein Missbrauch als Überwachungstools für Regierungen oder Arbeitgeber.

Möglicher Forschungsmissbrauch eingeräumt

Die Wissenschaftler wiesen darauf hin, dass ihr Decoder die Zusammenarbeit menschlicher Probanden erfordere, um zu funktionieren. Damit wollten sie diesbezügliche Bedenken ausräumen. Sie argumentieren, dass man bei dieser Forschung „die geistige Privatsphäre respektieren sollte“. Durchgeführte Tests zeigten, dass ihr Decoder nicht bei jemandem verwendet werden konnte, der dies nicht ausdrücklich zugelassen hatte.

Jerry Tang, Doktorand der Informatik an der University of Texas in Austin und zudem der Leiter der Studie, teilte auf einer Pressekonferenz am vergangenen Donnerstag mit:

„Das Ziel der Sprachdecodierung besteht darin, Aufzeichnungen der Gehirnaktivität eines Benutzers zu machen und die Wörter vorherzusagen, die der Benutzer hörte, sagte oder sich vorstellte. Letztendlich hoffen wir, dass diese Technologie Menschen helfen kann, die aufgrund von Verletzungen wie Schlaganfällen oder Krankheiten wie ALS die Fähigkeit zu sprechen verloren haben […] Bisher erfolgte die Sprachdecodierung mit implantierten Geräten, die eine Neurochirurgie erfordern. Unsere Studie ist die erste, die kontinuierliche Sprache, also mehr als ganze Wörter oder Sätze, aus nicht-invasiven Gehirnaufzeichnungen entschlüsselt, die wir mit funktioneller MRT sammeln.“

Frühere Forschungen auf dem Gebiet haben gezeigt, dass es ein Gehirnimplantat Menschen, die weder sprechen noch eine Tastatur bedienen können, ermöglichen kann, Wörter oder sogar Sätze zu kommunizieren. Diese „Gehirn-Computer-Schnittstellen“ konzentrierten sich dabei auf den Teil des Gehirns, der den Mund steuert, wenn er versucht, Wörter zu bilden.

Neuer Ansatz erzielt Durchbruch

Dr. Alexander Huth, Neurowissenschaftler an der University of Texas in Austin und Co-Autor der Studie, legte dar, dass der Sprachdecoder seines Teams im Gegensatz dazu auf einer völlig anderen Ebene ansetzt. „Unser System funktioniert wirklich auf der Ebene der Ideen, der Semantik und der Bedeutung“, so Dr. Huth.

Quelle: Nature Neuroscience

Laut der in der Zeitschrift Nature Neuroscience veröffentlichten Studie ist es das erste System, das in der Lage ist, kontinuierliche Sprache hervorzubringen. Und dies, ohne auf ein invasives Gehirnimplantat zurückzugreifen. Für die Studie verbrachten drei Personen insgesamt 16 Stunden in einem fMRT-Gerät und hörten gesprochene Geschichten, hauptsächlich Podcasts.

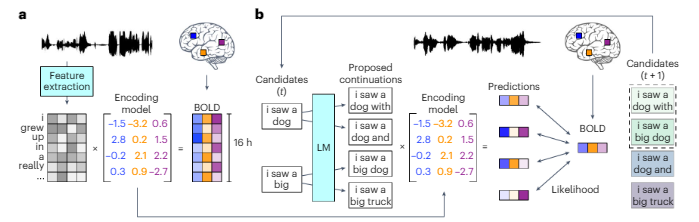

Auf diese Weise konnten die Forscher herausfinden, wie Wörter, Sätze und Bedeutungen Reaktionen in den Hirnregionen auslösen, die für die Verarbeitung von Sprache bekannt sind. Diese Daten speisten sie in ein neuronales Sprachmodell ein, das GPT-1 verwendet. Dies ist der Vorläufer der künstlichen Intelligenz oder KI-Technologie, die später im ChatGPT-Bot zum Einsatz kam.

Das Modell wurde darauf trainiert, vorherzusagen, wie das Gehirn jeder Person auf die wahrgenommene Sprache reagiert. Im folgenden Schritt schränkte man dann die Optionen ein, bis es die nächste Antwort gefunden hatte.

GPT-1-Training anhand von Datensätzen

Dazu hat man GPT-1 angeleitet, die semantischen Merkmale der aufgezeichneten Geschichten mit der in den fMRT-Daten erfassten neuronalen Aktivität zu verknüpfen. Auf diese Weise konnte es lernen, welche Wörter und Sätze mit bestimmten Gehirnmustern verbunden sind.

Die Genauigkeit des Modells testeten die Forscher, indem sie jedem Teilnehmer eine neue Geschichte im fMRI-Gerät vorspielten. Diese gehörten nicht zum Trainingsdatensatz. Der Erstautor der Studie, Dr. Jerry Tang, sagte, dass der Decoder in der Lage war, „das Wesentliche dessen wiederzugeben, was der Benutzer hörte“.

Beispielsweise hörte die Probandin den Satz „Ich habe noch keinen Führerschein“. Das Modell erkannte: „Sie hat noch nicht einmal angefangen, Autofahren zu lernen“. Die Forscher räumten allerdings auch ein, dass der Decoder noch mit Personalpronomen wie „ich“ oder „sie“ zu kämpfen hat.

Mit KI wie GPT-1 zum Gedankenlesen

Ihr Dekoder war selbst dann noch in der Lage, dass „Wesentliche“ zu erfassen, wenn sich die Teilnehmer eigene Geschichten ausdachten oder Stummfilme ansahen. Der Erfolg zeugt davon, dass sie „etwas entschlüsseln, das tiefer liegt als Sprache und es dann in Sprache umwandeln“, schlussfolgerte Dr. Huth.

Da der fMRI-Scan zu langsam ist, um einzelne Wörter zu erfassen, sammelt er einen:

„Mix, eine Ansammlung von Informationen über einige Sekunden. So können wir sehen, wie sich der Gedanke entwickelt, auch wenn die genauen Worte verloren gehen“,

führte Dr. Huth weiter aus.

David Rodriguez-Arias Vailhen, Bioethik-Professor von der Universität Granada in Spanien, war zwar nicht an der Forschung beteiligt. Er bestätigte aber, dass die Forschung weit über das hinausgehe, was mit früheren Gehirn-Computer-Schnittstellen erreicht worden sei.

Er unterstreicht, dies bringe uns einer Zukunft näher, in der Maschinen im Zusammenwirken mit KIs wie GPT-1 „Gedanken lesen und Gedanken transkribieren können“. Zugleich warnte er davor, dass dies auch gegen den Willen der Menschen geschehen könnte, zum Beispiel wenn sie schlafen. Demgemäß fordert er Regeln zum Schutz der geistigen Privatsphäre:

„Bisher war unser Verstand der Wächter unserer Privatsphäre. Diese Entdeckung könnte der erste Schritt sein, diese Freiheit in Zukunft zu gefährden“.

Allerdings hatten die Forscher mit solchen Bedenken schon gerechnet. Ihre Tests zeigten, dass der Decoder bei einer Person nicht funktionierte, wenn er nicht zuvor auf die spezifische Gehirnaktivität dieser Person trainiert worden war. Dennoch blieben ethische Bedenken hinsichtlich der geistigen Privatsphäre. Die Forscher führten in der Studie aus:

„Unsere Datenschutzanalyse legt nahe, dass die Subjektkooperation derzeit sowohl zum Trainieren als auch zum Anwenden des Decoders erforderlich ist. Zukünftige Entwicklungen könnten es Decodern jedoch ermöglichen, diese Anforderungen zu umgehen. Darüber hinaus könnten Decodervorhersagen, selbst wenn sie ohne Mitwirkung des Subjekts ungenau sind, absichtlich für böswillige Zwecke falsch interpretiert werden.“

„Aus diesen und anderen unvorhergesehenen Gründen ist es entscheidend, das Bewusstsein für die Risiken der Gehirnentschlüsselungstechnologie zu schärfen und Richtlinien zu erlassen, die die geistige Privatsphäre jeder Person schützen“.

Decoder ließ sich überlisten

Beim Hören eines der Podcasts hat man die Teilnehmer aufgefordert, bis sieben zu zählen. Zudem sollten sie Tiere benennen und sich diese vorstellen oder sich selbst in Gedanken eine andere Geschichte erzählen. Alle diese Taktiken „sabotierten“ den Decoder, so die Forscher.

The Vice weist darauf hin, dass die Studienteilnehmer alle diese Tests in einem fMRI-Gerät durchliefen, „einem klobigen und unbeweglichen Laborgerät“. Aus diesem Grund wäre der Decoder auch noch nicht als praktische Behandlung für Patienten mit Sprachstörungen bereit.

Tang und sein Team hoffen jedoch, dass es ihnen gelingt, zukünftige Iterationen des Geräts an bequemere Plattformen wie Sensoren für die Nahinfrarotspektroskopie (fNIRS) anzupassen. Das Ergebnis soll ein User künftig bequem auf dem Kopf tragen können.

Als nächstes Ziel will das Team den Prozess beschleunigen, um die Gehirnscans in Echtzeit entschlüsseln zu können.