Social Media ab 16? Immer mehr Länder fordern strengere Altersgrenzen. Erfahre, was sich in der EU und Deutschland gerade verändert.

Um Minderjährige besser vor schädlichen Inhalten wie Cybermobbing, exzessiver Bildschirmnutzung, Desinformation und Gewaltvideos zu schützen, hat Australien ein Mindestalter von 16 Jahren für die Nutzung sozialer Netzwerke eingeführt. Auch in Europa gewinnt die Debatte um strengere Alterskontrollen an Fahrt. Einige Länder fordern bereits verbindliche EU-weite Regelungen. Ab wann sollte man TikTok, Instagram & Co. nutzen dürfen? Die Forderung nach „Social Media ab 16“ gewinnt international an Rückhalt. Was plant Europa – und wie steht Deutschland dazu?

Laut einem aktuellen Bericht der Tagesschau vom 6. Juni 2025 will die Europäische Kommission neue, einheitliche Mindeststandards für digitale Plattformen setzen. Im Zentrum steht die Reform des Digital Services Act (DSA) – ein Gesetzesrahmen, der Anbieter von Online-Diensten stärker in die Verantwortung nimmt. Nicht-Einhaltung soll entsprechend Strafen nach sich ziehen.

Viele Social-Media-Plattformen geben bisher als Mindestalter 13 Jahre an. Wer jünger als 16 ist, braucht laut Plattformregeln zusätzlich die Einwilligung der Eltern. Rechtlich bindend sind diese Vorgaben jedoch nicht. In Deutschland gibt es derzeit kein Gesetz, das ein Mindestalter für soziale Medien festlegt. Altersverifikationen wie auf Porno-Plattformen gelten ansonsten als leicht zu umgehen.

Social Media ab 16 – Australien als Vorreiter

Als erstes Land weltweit setzte Australien im November 2024 eine Altersgrenze von 16 Jahren für soziale Medien wie TikTok, Instagram oder Facebook durch. Premierminister Anthony Albanese erklärte damals:

„Das ist für alle Mütter und Väter – wir wissen, wie sehr Sie sich um die Auswirkungen von Social Media auf Ihre Kinder sorgen.“

Der Gesetzesentwurf seiner Regierung zielt darauf ab, Kinder und Jugendliche gezielt vor gefährlichen Inhalten zu schützen – auch wenn verlässliche technische Altersnachweise bislang noch Mangelware sind.

Europa: Debatte um Altersgrenzen nimmt Fahrt auf

Auch in Europa gewinnt die Debatte um „Social Media ab 16“ an Fahrt. Es mehren sich die Stimmen für eine einheitliche Altersverifikation. Frankreichs Präsident Emmanuel Macron sprach sich Mitte Mai öffentlich im Sender TF1 für verpflichtende Alterskontrollen in sozialen Netzwerken aus. In Frankreich benötigen Kinder unter 15 bereits die Zustimmung ihrer Eltern für ein Social-Media-Konto. Dennoch bleibt die technische Umsetzung bislang lückenhaft.

Neben Frankreich fordern auch Griechenland, Spanien und Belgien konkrete Schritte von der EU-Kommission. Die belgische Medienministerin Jacqueline Galant spricht sich klar für ein europaweit einheitliches Mindestalter aus:

„Wenn Frankreich die Initiative ergreift, sollten alle europäischen Länder folgen.“

Deutschland: Diskussion auf politischer Ebene

In Deutschland steckt die Debatte allerdings noch in den Anfängen. Doch Initiativen wie „Smarter Start ab 14“ bringen Bewegung ins Spiel. Demnächst beschäftigt sich der Bundestag in einer Anhörung mit dem Thema. Auslöser ist die Petition der Initiative „Smarter Start ab 14“, die genügend Unterstützende gewinnen konnte. Verena Holler, eine der Organisatorinnen, kritisiert den fehlenden Schutz im Netz:

„Alkohol, Tabak, Glücksspiel – all das ist gesetzlich reguliert. Aber online ist alles für Kinder zugänglich: Pornografie, Gewaltvideos, Cybermobbing. Das darf so nicht bleiben.“

Im ARD-Podcast punktEU forderte sie, dass die Auswirkungen von Social Media auf Minderjährige ernster genommen werden müssten. Hoffnung setzt sie auf eine unabhängige Expertenkommission, wie sie bereits in Frankreich, Spanien und Dänemark aktiv ist.

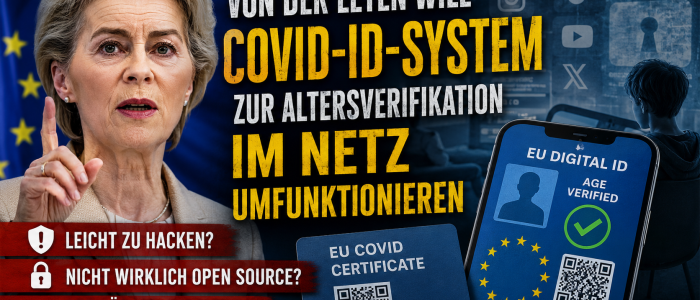

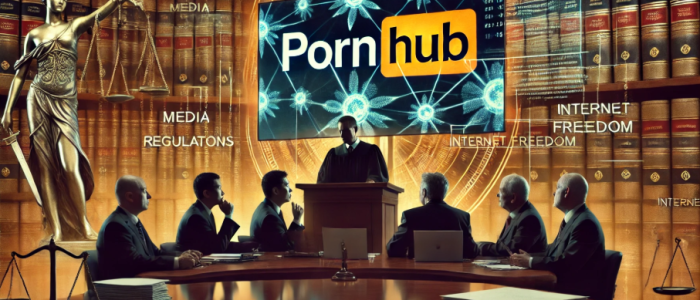

Die EU reagiert mit Gesetz und App

Mit dem Gesetz über digitale Dienste (DSA) will die EU-Kommission Plattformen stärker in die Verantwortung nehmen. Insbesondere Porno-Websites stehen im Verdacht, Altersabfragen unzureichend umzusetzen. Eine einfache Ja-/Nein-Frage reicht laut Kommission nicht aus. Entsprechende Prüfungen seien schon eingeleitet.

Leitlinien und technische Lösungen in Arbeit

Noch im Sommer will die EU-Kommission konkrete Leitlinien zur Umsetzung des DSA im Kinder- und Jugendschutz vorlegen. Darin vorgesehen:

- Voreinstellung von Nutzerkonten als „privat“

- Keine Gruppenbeitritte ohne ausdrückliche Zustimmung

- Anpassung der Empfehlungsalgorithmen

Parallel dazu wird eine EU-weite App zur Altersverifikation entwickelt. Nutzer sollen dort ihre Ausweisdaten einmalig hinterlegen. Bei Anfragen wird aber nur die Info „Mindestalter erreicht – ja/nein“ übermittelt. Datenschutz und Benutzerfreundlichkeit sollen im Fokus stehen. Der Start ist ebenfalls für den Sommer geplant. Die Initiative gilt als Übergangslösung. Im kommenden Jahr könnte eine sogenannte digitale Identitätsbörse folgen, in der beispielsweise Ausweis oder Führerschein digital hinterlegt werden.

Mit Beginn der Ratspräsidentschaft ab Juli kündigte Dänemark an, dem Thema eine zentrale Priorität einzuräumen. Der Schutz von Kindern im Netz werde im Zentrum ihrer Agenda stehen.

Fazit: Altersgrenze für Social Media – Symbolpolitik oder echter Schutz?

„Social Media ab 16“ – was nach einem sinnvollen Schritt zum Schutz junger Nutzer klingt, entpuppt sich in der Praxis oft als Symbolpolitik. Solange Plattformen Altersangaben nicht wirksam prüfen und gesetzliche Vorgaben fehlen, bleibt vieles Stückwerk. Australien geht voran, Europa diskutiert – aber es mangelt bisher an verbindlichen, durchsetzbaren Lösungen.

Die geplante Altersverifikations-App der EU mag ein Anfang sein, doch echte Kontrolle setzt mehr voraus: politische Entschlossenheit, technische Machbarkeit, Plattformverantwortung – und vor allem klare rechtliche Rahmenbedingungen, die durchsetzbar und sanktionierbar sind. Dass Kinder unter 14 heute problemlos auf Gewaltvideos und Pornografie stoßen, zeigt: Der Handlungsbedarf ist real – nicht theoretisch.

Ob sich daraus ein echter Schutz ergibt oder nur ein weiteres Regelwerk ohne Wirkung, braucht es klare Regeln, harte Sanktionen und eine Infrastruktur, die technisch funktioniert und rechtlich belastbar ist – ohne dabei die Privatsphäre aller Nutzer zu opfern.