Bei der britischen Tochter eines deutschen Energieunternehmens wurden durch einen per KI- gefakten CEO Fraud-Anruf 220.000 Euro abgezogen.

Die Methode „CEO fraud“ gleicht im Wesentlichen dem „Enkeltrick“. Täter rufen hierbei zumeist in der Firmenbuchhaltung an und geben vor, der Geschäftsführer zu sein. Sie sind gut informiert durch öffentliche Quellen. Doch die Täter sind diesmal neue und moderne Wege gegangen, um ihr Ziel zu erreichen.

Die Kriminellen bringen durch geschickt gewählte Argumente Mitarbeiter dazu, Firmengelder ins Ausland zu transferieren, wo sie auf Nimmerwiedersehen verschwunden bleiben. In einem erst kürzlich aufgetretenem Fall ist es Betrügern mittels Künstlicher Intelligenz (KI) gelungen, die Stimme des echten CEO so täuschend echt zu imitieren, dass ihre Geldforderung in Höhe von 243.000 US-Dollar bzw. 220.000 Euro sofort erfüllt wurde, berichtet das Wall Street Journal.

Stimmen-Imitations-Software lernt dazu – ermöglicht CEO Fraud

Der „Chef-Betrug“ stellt eine wachsende Bedrohung für Unternehmen dar, zumal er dank Fortschreitens der Technik immer erfolgreicher ausgeführt werden kann. Die Stimmen-Imitations-Software basiert auf „Machine Learning“ und kann innerhalb von nur wenigen Minuten durch einen selbstlernenden Algorithmus die Stimme eines Menschen studieren und anschließend nachahmen, einschließlich der individuellen Sprachmelodie oder dem landestypischen Akzent.

Dringlichkeit gekoppelt mit einer täuschend echten Stimme

Genau dieser Trick griff auch beim Anruf des vermeintlich deutschen CEO eines Energieunternehmens mit dem Chef der britischen Tochtergesellschaft. Er wandte sich an ihn mit der Bitte um eine dringende Überweisung. Als Begründung berief sich der CEO darauf, dass er den Transaktionszeitraum der Bank am Freitagnachmittag leider verpasst hat. Die Überweisung hätte man noch vor 16 Uhr tätigen müssen, damit die Zahlung pünktlich vor dem Wochenende eingeht. Er gab an, dass nur mit Hilfe des britischen Tochterunternehmens die Transaktion dank der Zeitverschiebung von einer Stunde (in Großbritannien war es erst 15 Uhr) noch möglich wäre. Der Chef der Tochtergesellschaft wunderte sich zwar ein wenig, stimmte jedoch zu, da er die Stimme eindeutig erkannte, 243.000 US-Dollar für einen „ungarischen Lieferanten“ an die angegebene Kontonummer zu überweisen. Hinter diesem Verkäuferkonto versteckte sich tatsächlich das Bankkonto der Gauner.

Genau dieser Trick griff auch beim Anruf des vermeintlich deutschen CEO eines Energieunternehmens mit dem Chef der britischen Tochtergesellschaft. Er wandte sich an ihn mit der Bitte um eine dringende Überweisung. Als Begründung berief sich der CEO darauf, dass er den Transaktionszeitraum der Bank am Freitagnachmittag leider verpasst hat. Die Überweisung hätte man noch vor 16 Uhr tätigen müssen, damit die Zahlung pünktlich vor dem Wochenende eingeht. Er gab an, dass nur mit Hilfe des britischen Tochterunternehmens die Transaktion dank der Zeitverschiebung von einer Stunde (in Großbritannien war es erst 15 Uhr) noch möglich wäre. Der Chef der Tochtergesellschaft wunderte sich zwar ein wenig, stimmte jedoch zu, da er die Stimme eindeutig erkannte, 243.000 US-Dollar für einen „ungarischen Lieferanten“ an die angegebene Kontonummer zu überweisen. Hinter diesem Verkäuferkonto versteckte sich tatsächlich das Bankkonto der Gauner.

Wiederholung vom CEO Fraud misslang

Aufgrund des ersten Erfolgs versuchten die Betrüger, eine zweite Zahlung zu fordern, diesmal jedoch vergebens. Hier behauptete der Kriminelle, dass die Bank die Überweisung zurückerstattet hätte. Er verlangte in einem dritten Anruf nochmals, das Geld zu überweisen. Dem Manager in Großbritannien kamen Zweifel auf, als er feststellte, dass die Telefonnummer des vermeintlich deutschen CEO aus Österreich kam. Er veranlasste Nachforschungen und stellte fest, dass das Geld nicht zurückerstattet wurde. Stattdessen hat man es über eine ungarische Bank nach Mexiko transferiert und dort verschwand es spurlos.

Aufgrund des ersten Erfolgs versuchten die Betrüger, eine zweite Zahlung zu fordern, diesmal jedoch vergebens. Hier behauptete der Kriminelle, dass die Bank die Überweisung zurückerstattet hätte. Er verlangte in einem dritten Anruf nochmals, das Geld zu überweisen. Dem Manager in Großbritannien kamen Zweifel auf, als er feststellte, dass die Telefonnummer des vermeintlich deutschen CEO aus Österreich kam. Er veranlasste Nachforschungen und stellte fest, dass das Geld nicht zurückerstattet wurde. Stattdessen hat man es über eine ungarische Bank nach Mexiko transferiert und dort verschwand es spurlos.

Das Versicherungsunternehmen Euler Hermes, eine Tochter der Allianz, hat sich mit dem CEO Fraud-Schadensfall auseinandergesetzt. Der Fall ist bereits vom März diesen Jahres, die Namen der betroffenen Firmen hat man absichtlich nicht bekannt gegeben. Ron van het Hof, CEO des Kreditversicherungsunternehmens Euler Hermes in Deutschland, Österreich und der Schweiz, warnt: „Die Täter gehen immer gewiefter vor. Mit der erstmaligen Nutzung von künstlicher Intelligenz bei der Fake President Betrugsmasche erreichen wir eine neue Evolutionsstufe. Das ist aber erst der Anfang: Software zur Stimm- oder Handschriftenimitation oder auch Deepfake-Videos eröffnen Betrügern in Zukunft noch viele neue Möglichkeiten. In einem oder zwei Jahren gibt es vielleicht den ersten Fake President Fall, bei dem die Zahlungsanweisung per Deepfake-Video per WhatsApp kam.“

Noch keine Imitation der deutschen Stimme möglich

Rüdiger Kirsch, Betrugsexperte bei Euler Hermes, verrät. „Bei uns heißt dieser Schadensfall (mit dem CEO Fraud) ‚Der falsche Johannes‘: Der falsche Chef hat die richtige Stimme.“ Er weist darauf hin, dass es kein Zufall ist, „dass es ausgerechnet eine britische Tochter des Unternehmens war, die Ziel des Betrugs wurde. Die Zeitverschiebung ist dafür zwar nicht ausschlaggebend, sondern vielmehr die Tatsache, dass die vermutlich verwendete Stimmimitations-Software aktuell nur Englisch kann. Unternehmen sollten folglich ihre ausländischen Niederlassungen besonders sensibilisieren, dass die Betrüger ihre Masche weiterentwickelt haben.“

Rüdiger Kirsch, Betrugsexperte bei Euler Hermes, verrät. „Bei uns heißt dieser Schadensfall (mit dem CEO Fraud) ‚Der falsche Johannes‘: Der falsche Chef hat die richtige Stimme.“ Er weist darauf hin, dass es kein Zufall ist, „dass es ausgerechnet eine britische Tochter des Unternehmens war, die Ziel des Betrugs wurde. Die Zeitverschiebung ist dafür zwar nicht ausschlaggebend, sondern vielmehr die Tatsache, dass die vermutlich verwendete Stimmimitations-Software aktuell nur Englisch kann. Unternehmen sollten folglich ihre ausländischen Niederlassungen besonders sensibilisieren, dass die Betrüger ihre Masche weiterentwickelt haben.“

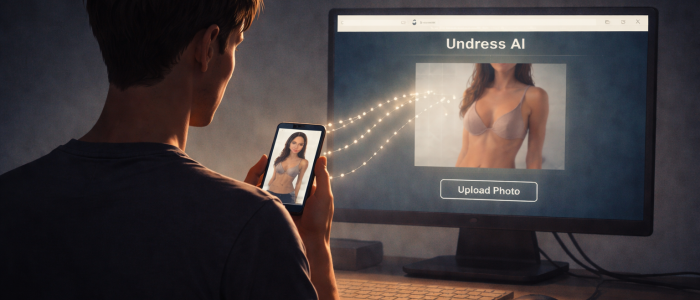

Bildquelle: bssmadeit, thx! (Pixabay Lizenz)

Tarnkappe.info