Forscher schufen für 25 KI-Agenten die virtuelle Stadt Smallville und beobachten sie nun bei der Gestaltung ihres Alltags.

In einer Kombination aus dem Zusammenwirken von ChatGPT und Sims wollen sich Forscher ein Bild über die Fähigkeiten und Grenzen ihrer KI-Agenten verschaffen. Dazu verhelfen soll ihnen eine Simulation menschlichen Verhaltens über deren individuelle Interaktionen in der eigens dafür entworfenen Stadt Smallville.

An der Studie „Generative Agents: Interactive Simulacra of Human Behavior“ wirken sechs Informatiker der Stanford University bzw. einer von Google Research mit. Konkret daran beteiligt sind Joon Sung Park, Joseph O’Brien, Carrie Cai, Meredith Ringel Morris, Percy Liang und Michael Bernstein.

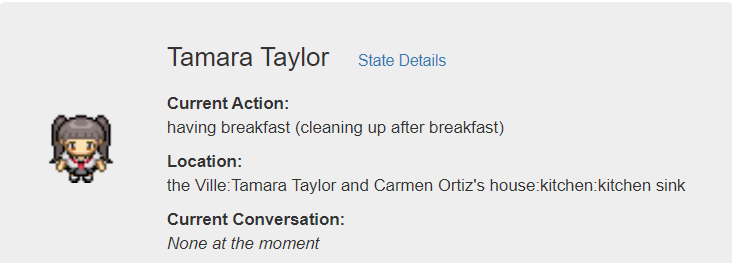

Im Rahmen ihrer Studie bevölkern KI-Agenten die virtuelle Stadt Smallville. Eine Gesellschaft von 25 Bots mit künstlicher Intelligenz (KI) kann man infolge dabei beobachten, wie sie aufwachen, Frühstück kochen, zur Arbeit gehen. Ferner treffen sie sich mit Freunden zum Mittagessen oder in einer Bar oder sie veranstalten sogar eine Party.

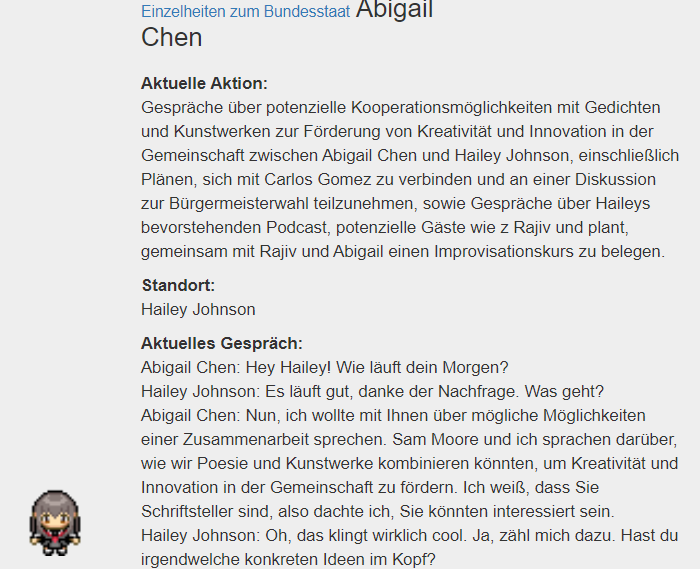

In der Simulation können die KI-Agenten eine Vielzahl von Rückschlüssen auf sich selbst, andere Agenten und ihre Stadt Smallville ziehen. Sie können neue Informationen synthetisierten, diese im Gedächtnis abspeichern und sich dann auf eine Weise verhalten, die dieses Wissen widerspiegelt.

Gemäß The Register entwickelten die Forscher eine Softwarearchitektur, die „relevante Erinnerungen speichert, synthetisiert und anwendet, um unter Verwendung eines großen Sprachmodells glaubwürdiges Verhalten zu erzeugen“.

Dabei haben sie ChatGPT mit Gedächtnis, Reflexion (Schlussfolgerung aus Erinnerungen) und Planungscode versehen, um generative KI-Agenten zu erstellen. Diese sind simulierte Persönlichkeiten, die interagieren und ihre eigenen Ziele verfolgen, indem sie Textkommunikation in einer versuchten natürlichen Sprache verwenden. Die Forscher erklären:

„In dieser Arbeit demonstrieren wir generative Agenten, indem wir eine Sandbox-Umgebung, die an Die Sims erinnert, mit fünfundzwanzig Agenten bevölkern. Benutzer können beobachten und eingreifen, während Agenten ihre Tage planen, Neuigkeiten austauschen, Beziehungen aufbauen und Gruppenaktivitäten koordinieren.“

KI-Agenten erzeugen glaubwürdige menschliche Verhaltensweisen

Beispielsweise können die KI-Agenten Pläne koordinieren oder über Gespräche mit anderen Agenten interagieren. Die Ergebnisse führten die Forscher zu dem Schluss, dass die generativen Agenten „glaubwürdige“ menschliche Verhaltensweisen erzeugen:

„Durch die Verschmelzung großer Sprachmodelle mit computergestützten, interaktiven Agenten führt diese Arbeit Architektur- und Interaktionsmuster ein, um glaubwürdige Simulationen menschlichen Verhaltens zu ermöglichen.“

Auch für Besucher ist diese Demo-Welt einsehbar. Sie wird auf einer Heroku Cloud Application Platform ausgeführt. Erstellt wurde sie mit dem Phaser-Framework. Besucher können mit der Sitzungswiedergabe interagieren, während diese Software-Agenten ihrem Leben nachgehen.

Die Demo ermöglicht es den Besuchern von Smallville, die Zustandsdaten der simulierten Persönlichkeiten zu untersuchen. Das heißt, Sie können sie anklicken und ihre Texterinnerungen und andere Informationen über sie sehen.

Einsatz von KI-Agenten in Smallville verhilft Forschern zu Erkenntnissen

Das Ziel dieser Forschung ist es, über grundlegende Arbeiten wie die Eliza-Engine aus den 1960er Jahren und über Ansätze des Reinforcement Learning wie AlphaStar für Starcraft und OpenAI Five für Dota 2 hinauszugehen, die sich auf gegnerische Umgebungen mit klaren Siegzielen und eine Softwarearchitektur konzentrieren, die für programmatische Agenten geeignet ist. Die Forscher veranschaulichen:

„In den letzten vier Jahrzehnten ist eine Vielzahl von Ansätzen zur Schaffung glaubwürdiger KI-Agenten entstanden. Bei der Implementierung vereinfachten diese Ansätze jedoch häufig die Umgebung oder Dimensionen des Agentenverhaltens, um den Aufwand überschaubarer zu machen. Ihr Erfolg fand jedoch größtenteils in gegnerischen Spielen mit leicht definierbaren Belohnungen statt, für die ein Lernalgorithmus optimiert werden kann.“

Laut den Experten codierten Sprachmodelle wie ChatGPT ein breites Spektrum menschlichen Verhaltens. Dies könnte für eine automatisierte Interaktion nützlich sein, die nicht auf eine bestimmte Reihe von vorprogrammierten Fragen und Antworten beschränkt ist.