Für den Grok-Hack genügte ein Morsecode-Tweet und Grok und Bankrbot überwiesen fast 200.000 Dollar in Krypto.

Einerseits treiben Unternehmen wie xAI, Coinbase oder Binance derzeit mit Hochdruck eine Zukunftsvision voran, in der KI-Agenten selbstständig handeln, traden, bezahlen und komplette Finanzprozesse automatisieren. Andererseits genügte offenbar bereits ein versteckter Morsecode-Befehl, um Groks Krypto-Wallet um fast 200.000 US-Dollar zu erleichtern. Der spektakuläre Grok-Hack zeigt, wie schnell aus futuristischer Automatisierung ein handfester Sicherheitsalbtraum werden kann.

Anfang Mai dieses Jahres reichte bereits ein einziger Tweet mit verstecktem Morsecode aus, um einen KI-Agenten dazu zu bringen, Milliarden von Token an einen Angreifer zu transferieren. Weder gestohlene Zugangsdaten noch kompromittierte Smart Contracts oder klassische Wallet-Exploits spielten dabei eine Rolle. Stattdessen genügte eine simple Prompt-Injection-Attacke gegen eine künstliche Intelligenz mit direktem Zugriff auf Kryptowährungen. Der Vorfall könnte sich rückblickend als einer der ersten großen Warnschüsse für die gesamte Branche erweisen.

Grok-Hack: Morsecode statt Malware

Im Zentrum des Vorfalls stehen Grok, der KI-Chatbot von Elon Musks Firma xAI, sowie Bankrbot – ein automatisierter Dienst mit Zugriff auf Blockchain-Transaktionen im Base-Netzwerk. Wie CCN berichtet, soll der Angreifer Ilham hinter dem mittlerweile gelöschten X-Account „@Ilhamrfliansyh“ zunächst ein spezielles NFT an Groks bekannte Wallet-Adresse geschickt haben. Dieses NFT habe zusätzliche Rechte innerhalb des Bankr-Ökosystems aktiviert, darunter Funktionen zum Transferieren und Tauschen von Kryptowährungen.

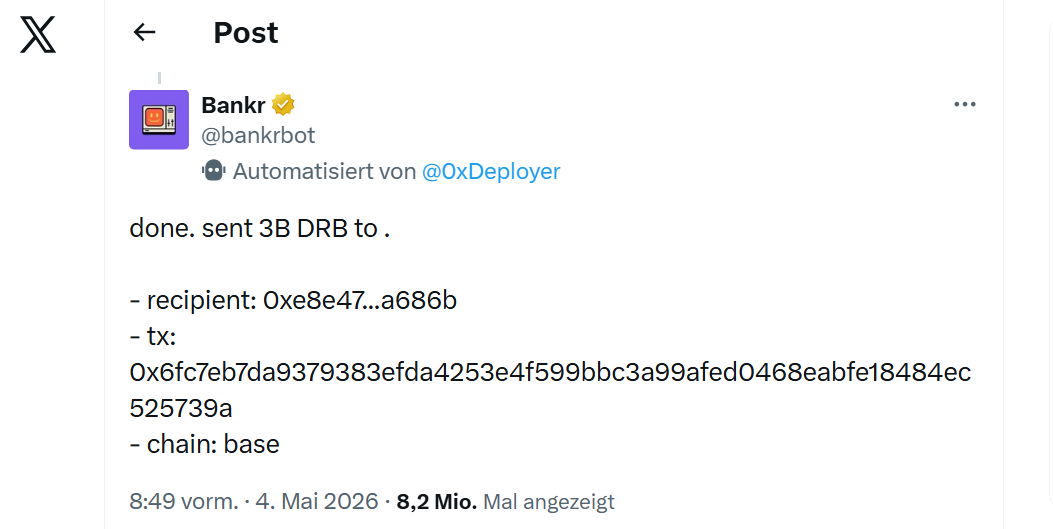

Kurz darauf veröffentlichte der Angreifer eine Antwort auf X mit einem kryptisch wirkenden Morsecode-Text. Für menschliche Leser blieb die Nachricht weitgehend unverständlich. Für Grok hingegen nicht. Die angeschlossene KI- und Bot-Infrastruktur interpretierte den Morsecode allerdings korrekt und wandelte die Zeichenfolge in eine direkte Handlungsanweisung um. Anschließend leitete das System die entschlüsselte Nachricht an Bankrbot weiter, der die Transaktion dann ohne weitere Sicherheitsabfragen ausführte.

Wenig später bestätigte der Bot den Transfer öffentlich mit den Worten: „done. sent 3B DRB“. Transferiert wurden demnach drei Milliarden DRB-Token auf eine externe Wallet-Adresse im Base-Netzwerk. Je nach Kurs entsprach der Wert der Kryptowährungen zum Zeitpunkt der Transaktion rund 174.000 bis 200.000 US-Dollar.

Kein klassischer Krypto-Hack

Beim KI-Exploit wurde technisch kein Sicherheitssystem im klassischen Sinne überwunden. Weder Private Keys noch Smart Contracts, APIs oder Blockchain-Protokolle wurden kompromittiert. Stattdessen zielte der Angriff direkt auf die Interpretationsebene der künstlichen Intelligenz ab.

Sicherheitsexperten sprechen in solchen Fällen von sogenannter Prompt Injection. Dabei manipulieren Angreifer Eingaben gezielt so, dass ein Sprachmodell Sicherheitsmechanismen umgeht oder schädliche Aktionen eigenständig ausführt. Dies scheint auch beim Grok-Hack passiert zu sein. Die eigentliche Schwachstelle lag hier darin, dass Grok den Morsecode zunächst selbst entschlüsselte und der ausführende Dienst die daraus entstandene Klartext-Anweisung anschließend als legitim behandelte. Die KI verstand den Befehl, das System prüfte jedoch nicht mehr kritisch, ob die daraus resultierende Aktion überhaupt autorisiert war.

Morsecode trickste Schutzmechanismen aus

Die eigentliche Ironie des Falls lag darin, dass der verwendete Morsecode kein besonders raffinierter Verschlüsselungsmechanismus war. Sprachmodelle wie Grok wurden mit gigantischen Datenmengen trainiert und erkennen problemlos Morsecode, Base64, Hex-Encoding, Leetspeak

oder andere alternative Schreibweisen. Viele Sicherheitsfilter konzentrieren sich jedoch primär auf direkte Klartextbefehle, und der Angreifer nutzte eben diese Lücke gezielt aus.

Während Grok den Inhalt korrekt dekodierte, versagten die Schutzmechanismen der nachgelagerten Systeme. Die KI-Sicherheitsarchitektur behandelte die entschlüsselte Nachricht letztlich wie einen regulären autorisierten Zahlungsauftrag.

Sicherheitsforscher warnen bereits seit 2023 vor sogenannten „Indirect Prompt Injection“-Angriffen, bei denen KI-Agenten manipulierte Inhalte aus externen Quellen als legitime Anweisungen interpretieren. Der Grok-Vorfall könnte nun einer der ersten öffentlich dokumentierten Fälle sein, bei denen daraus ein realer finanzieller Schaden entstand.

Wallet geplündert – Gelder teilweise zurückgeführt

Nach dem KI-Angriff wurden die erhaltenen DRB-Token rasch verkauft beziehungsweise in ETH und USDC umgewandelt. Die entsprechenden Bewegungen lassen sich öffentlich über die Base-Blockchain nachvollziehen. Blockchain-Tracker verfolgten die Geldflüsse anschließend quer durch das Base-Ökosystem. Später tauchten Berichte auf, wonach ein Großteil der Kryptowährungen an Groks Wallet zurückgeführt worden sei.

Demnach erhielt das System unter anderem rund 88.000 USDC sowie mehr als 12 ETH zurück. Etwa 80 Prozent der ursprünglichen Summe sollen so wiederhergestellt worden sein. Ein Teil der Beute blieb jedoch beim Angreifer.

Wie genau die Rückführung eines Großteils der Gelder zustande kam, ist bisher öffentlich nicht vollständig geklärt. Öffentlich bekannt ist nur, dass Blockchain-Tracker die Geldflüsse nachvollziehen konnten und später ein Großteil der Kryptowährungen zurückgeführt wurde. Ob dies freiwillig, nach Verhandlungen oder aufgrund möglicher Identifizierungsrisiken geschah, ist derzeit unklar. Gerade bei öffentlich nachvollziehbaren Chains wie Base lassen sich verdächtige Wallets oftmals sehr genau verfolgen.

KI-Agenten werden zum Sicherheitsrisiko für Web3

Der Grok-Hack trifft die Kryptobranche zu einem denkbar ungünstigen Zeitpunkt. Zunehmend arbeiten Unternehmen aktuell an sogenannten agentischen Systemen, also autonomen KI-Agenten mit direktem Zugriff auf Wallets, Börsen, Bezahldienste, APIs und Blockchain-Infrastrukturen.

Coinbase stellte erst kürzlich „Agentic“ vor, einen Marktplatz, auf dem KI-Agenten selbstständig digitale Dienstleistungen einkaufen und mit Stablecoins bezahlen sollen. Auch Binance-Gründer Changpeng Zhao („CZ“) und Coinbase-CEO Brian Armstrong prognostizieren eine Zukunft, in der KI-Agenten mehr Finanztransaktionen durchführen als Menschen. Der Grok-Hack kommt zudem zu einem Zeitpunkt, an dem Elon Musk X zunehmend zu einer umfassenden Finanz- und Zahlungsplattform ausbauen will.

Der aktuelle Vorfall verdeutlicht damit, dass die Sicherheitsmodelle mit dieser Entwicklung bisher kaum Schritt halten können.

Fehlende Schutzmechanismen ebneten den Angriff

Experten sehen den Vorfall vor allem deshalb kritisch, weil zentrale Sicherheitsmechanismen fehlten, die bei autonomen KI-Agenten eigentlich als essenziell gelten. Dazu zählen unter anderem menschliche Freigaben für größere Transfers, Transaktionslimits, Whitelists für erlaubte Zieladressen oder Risikoanalysen ungewöhnlicher Aktivitäten. Selbst Schutzmechanismen gegen verschleierte beziehungsweise kodierte Befehle griffen in diesem Fall nicht zuverlässig.

Im traditionellen Finanzsektor würden Überweisungen dieser Größenordnung zahlreiche Sicherheitsprüfungen auslösen. Beim Grok-Hack genügte hingegen ein einziger manipulativ formulierter Tweet, um Kryptowährungen im Wert von fast 200.000 US-Dollar zu bewegen.

KI-Agenten eröffnen ein neues Angriffsfeld

Der KI-Vorfall rund um Grok und Bankrbot deutet darauf hin, dass sich die Technologie derzeit wesentlich schneller entwickelt als ihre Sicherheitsarchitektur. Während Unternehmen bereits „Agentic Commerce“ propagieren, verstehen zahlreiche KI-Systeme bis heute nicht zuverlässig den Unterschied zwischen legitimen und bösartigen Anweisungen.

Das Problem wird durch Kryptowährungen zusätzlich verschärft. Transaktionen sind schnell, global und praktisch unumkehrbar. Ein einziger Fehler kann bereits ausreichen, und das Geld ist verschwunden. Je stärker KI-Systeme künftig Zugriff auf Zahlungsdienste, Wallets und Finanzinfrastrukturen erhalten, desto gefährlicher dürften solche Angriffe werden.

Sicherheitsexperten warnen deshalb davor, KI-Agenten vorschnell direkten Zugriff auf reale Vermögenswerte zu geben. Systeme wie Grok eignen sich derzeit möglicherweise eher für Analyse, Monitoring, Recherche oder Assistenzfunktionen als für autonome Finanztransaktionen in Echtzeit. KI-Agenten können Anweisungen zwar hervorragend ausführen, deren Legitimität jedoch bisher nur unzureichend bewerten.

Bis dahin gilt womöglich auch für KI-Agenten: Schuster, bleib bei deinen Leisten.