Light Commands: Sprachassistenten können per Laserstrahl so gesteuert werden, dass sie auf fremde Kommandos hören und diese Befehle befolgen.

Haben wir in der Vergangenheit bereits von der Hackanfälligkeit smarter Systeme berichtet, insbesondere von Sprachassistenten. So gelingt es Sicherheitsforschern zunehmend, diese Angriffsmethoden zu erweitern und zu perfektionieren, wie auch hier mit Light Commands. Forschern der Universität von Michigan ist es mittels eines Lasers gelungen, Sprachassistenten völlig unbemerkt zu steuern, berichtet arstechnica.

Light Commands zielen auf Sprachassistenten

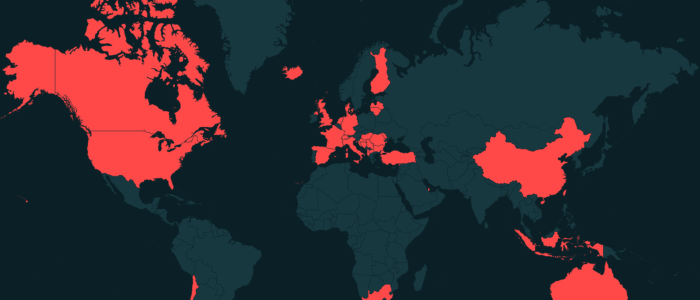

Siri, Alexa und Google Assistant sind anfällig für Angriffe, bei denen mit Hilfe von Laserstrahlen unhörbare und unsichtbare Befehle in die Geräte injiziert werden. Diese werden dadurch heimlich veranlasst, Garagentore zu öffnen, Websites zu besuchen oder Fahrzeuge, wie Tesla und Ford, zu lokalisieren, zu entriegeln und zu starten, wenn die Fahrzeuge mit dem Google-Konto des Angriffs-Ziels verbunden sind.. Möglich sind weiterhin das Steuern von Smart-Home-Schaltern, das Öffnen smarter Schlösser unter Ausnutzung der Benutzer-PINs, aber auch Einkäufe lassen sich, gemäß dem Forschungsbericht „Laser-based Audio Injection Attacks auf sprachgesteuerten Systemen“, online erledigen. Der Angriff, genannt Light Commands, funktioniert zudem auch bei Smartphones und Tablet-PCs, darunter dem iPhone XR und dem Samsung Galaxy S9, sowie einer Vielzahl weiterer Handys.

Siri, Alexa und Google Assistant sind anfällig für Angriffe, bei denen mit Hilfe von Laserstrahlen unhörbare und unsichtbare Befehle in die Geräte injiziert werden. Diese werden dadurch heimlich veranlasst, Garagentore zu öffnen, Websites zu besuchen oder Fahrzeuge, wie Tesla und Ford, zu lokalisieren, zu entriegeln und zu starten, wenn die Fahrzeuge mit dem Google-Konto des Angriffs-Ziels verbunden sind.. Möglich sind weiterhin das Steuern von Smart-Home-Schaltern, das Öffnen smarter Schlösser unter Ausnutzung der Benutzer-PINs, aber auch Einkäufe lassen sich, gemäß dem Forschungsbericht „Laser-based Audio Injection Attacks auf sprachgesteuerten Systemen“, online erledigen. Der Angriff, genannt Light Commands, funktioniert zudem auch bei Smartphones und Tablet-PCs, darunter dem iPhone XR und dem Samsung Galaxy S9, sowie einer Vielzahl weiterer Handys.

Neuartiger Angriffsmodus basiert auf physikalischen Gesetzen

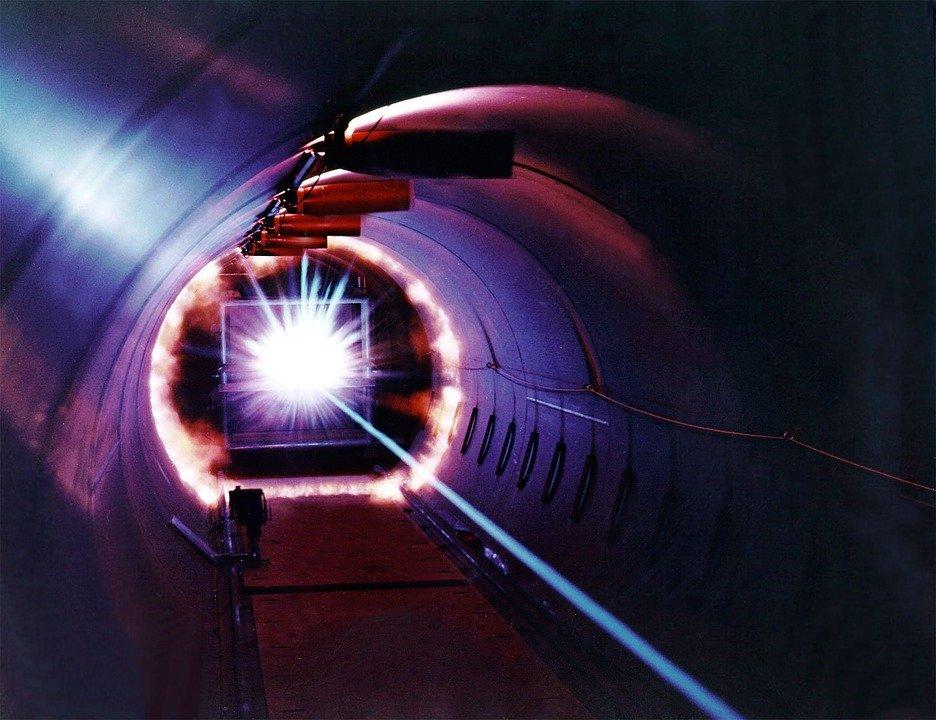

Für diesen neuartigen Angriffsmodus nutzen die Forscher physikalische Gesetze zum Hack. Sie erklären es wie folgt: „Mikrofone wandeln Schall in elektrische Signale um. Die wichtigste Erkenntnis hinter den Laserbefehlen ist, dass Mikrofone neben dem Ton auch direkt auf sie gerichtetes Licht reagieren. Durch die Modulation eines elektrischen Signals in der Intensität eines Lichtstrahls, können Angreifer Mikrofone dazu veranlassen, elektrische Signale zu erzeugen und so zu nutzen, als ob sie echte Audiosignale empfangen würden.“ Umgesetzt wird es, indem auf einen Sprachassistent ein niedrigfrequenter Lichtstrahl gerichtet wird. Über diesen werden aus einer Entfernung von bis zu 110 m (360 Fuß) unhörbare Signale eingeben und übertragen. Der Sprachassistent reagiert darauf und führt die empfangenen Befehle entsprechend aus. Unter anderem können lichtbasierte Befehle von einem Gebäude zu einem anderen gesendet werden und selbst durch Glas dringen, wenn ein gefährdetes Gerät in der Nähe eines geschlossenen Fensters aufbewahrt wird.

Schwachstelle sind Sicherheitsanfälligkeit in Mikrofonen

Der Angriff nutzt eine Sicherheitsanfälligkeit in Mikrofonen aus, die mikroelektromechanische Systeme oder MEMS verwenden. Die mikroskopischen MEMS-Komponenten dieser Mikrofone reagieren ungewollt auf Licht, als wäre es Schall. Die Forscher glauben, dass alle Geräte, die MEMS-Mikrofone verwenden, für Light Commands-Angriffe anfällig sind. Sprachassistenten verlassen sich grundsätzlich auf Stimm-Interaktionen zur Entgegennahme von Sprachbefehlen. Indem ein Angreifer einen Laser auf dessen Mikrofone richtet, kann er den Sprachassistenten effektiv übernehmnen und unhörbare Befehle an Alexa, Siri oder Google Assistant senden. Licht kann leicht weite Strecken zurücklegen. Dadurch ist der Angreifer in der Lage, den Laserstrahl zu fokussieren und zu zielen. Die Forscher demonstrierten den Angriff in einem 110 Meter langen Flur.

Funktionsweise der Light Commands

Damit Lichtbefehle funktionieren, sind sorgfältiges Zielen und Fokussieren mit dem Laser Grundvorraussetzung. Um den Laser über große Entfernungen genau auf einen Punkt auszurichten, kann man ein handelsübliches Teleobjektiv verwenden. Für das Zielen empfiehlt man einen Stativkopf mit Getriebe. Das erhöht die Genauigkeit erheblich. Um die Mikrofonanschlüsse des Geräts in großen Entfernungen zu erkennen, reicht die Verwendung eines Teleskops oder Fernglases.

Verfahrens-Einschränkungen

Die lasergestützten Angriffe weisen mehrere Einschränkungen auf. Zum einen muss der Angreifer eine direkte Sichtlinie zum Zielgerät haben. Und zum anderen muss das Licht in vielen Fällen genau auf einen bestimmten Teil des Mikrofons gerichtet sein. Außer in Fällen, in denen ein Angreifer einen Infrarotlaser verwendet, sind die Lichter auch für Personen in der Nähe und mit Blickrichtung auf das Gerät gut sichtbar. Darüber hinaus reagieren die Light Commands bei der Ausführung eines Befehls in der Regel mit Sprach- und visuellen Hinweisen. Diese Funktion warnt Benutzer, die sich in Hörweite des Geräts befinden.

Bildquelle: WikiImages, thx!

Tarnkappe.info